TL;DR — Points clés

- Les LLM ne classent pas les pages comme Google — ils prédisent le texte le plus utile à inclure dans une réponse, et l'attribuent aux sources vues lors de l'entraînement ou récupérées en temps réel.

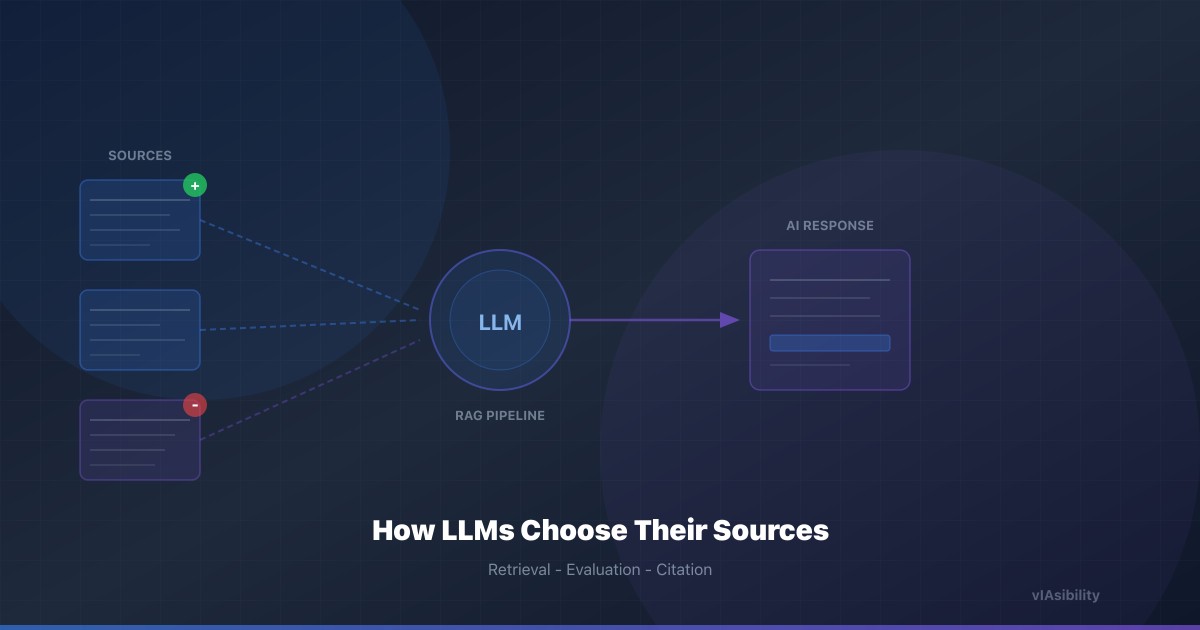

- Le RAG (Retrieval-Augmented Generation) est aujourd'hui l'architecture dominante pour les réponses IA factuelles : le modèle interroge un index externe, récupère des passages candidats, puis les synthétise.

- La position dans le contexte récupéré, la clarté du passage, la densité factuelle et l'autorité de la source influencent directement si votre contenu sera cité.

- La recherche académique de 2024–2025 quantifie ces effets — et fournit un plan d'action concret pour les créateurs de contenu.

Pourquoi c'est important maintenant

La conversation autour du GEO se concentre souvent sur quoi optimiser — données structurées, ton factuel, fraîcheur — sans expliquer pourquoi ces techniques fonctionnent au niveau du modèle. C'est un problème, car comprendre comment les LLM sélectionnent leurs sources permet de prendre de meilleures décisions sur l'architecture du contenu, pas seulement son formatage.

Début 2026, le paysage a radicalement évolué. ChatGPT avec recherche représente environ 78 % de tout le trafic web référé par les IA, et Perplexity en génère 15 %. Les AI Overviews de Google apparaissent sur plus de 30 % des requêtes desktop aux États-Unis, contre 13 % un an plus tôt. Ces systèmes partagent tous un trait commun : ils récupèrent du contenu externe et le synthétisent dans une réponse. Comprendre le pipeline de récupération et de synthèse est donc la clé pour être cité.

Les deux chemins pour être cité par un LLM

Il existe fondamentalement deux façons pour votre contenu de se retrouver dans une réponse générée par une IA :

1. Connaissance paramétrique (données d'entraînement)

Le modèle a « mémorisé » votre contenu pendant le pré-entraînement. Cela se produit quand vos pages ont été incluses dans le corpus d'entraînement — généralement Common Crawl, Wikipédia ou d'autres collections web à grande échelle. L'information utilisée de cette façon est souvent paraphrasée sans attribution explicite.

Le problème : vous n'avez quasiment aucun contrôle sur ce processus. Les données d'entraînement sont sélectionnées des mois, voire des années, avant le déploiement du modèle. Vous ne pouvez pas insérer rétroactivement votre contenu de 2026 dans un modèle entraîné sur des données de 2024.

2. Connaissance récupérée (RAG)

C'est là que vous avez un levier direct. Dans le RAG (Retrieval-Augmented Generation), le modèle interroge un index de recherche externe en temps réel, récupère les documents pertinents et les utilise comme contexte pour générer sa réponse. C'est ainsi que fonctionnent ChatGPT avec recherche, Perplexity, Google AI Overviews et Bing Copilot.

Une étude de 2024 d'Asai et al. (« Self-RAG: Learning to Retrieve, Generate, and Critique through Self-Reflection ») a montré que les systèmes RAG modernes ne copient pas aveuglément les passages récupérés — ils évaluent la pertinence, la cohérence et le fondement factuel avant d'incorporer l'information. Cela signifie que la qualité et la structure de votre contenu influencent directement son utilisation.

Comment les systèmes RAG évaluent votre contenu

Quand un utilisateur pose une question à un LLM augmenté par la recherche, voici ce qui se passe en coulisses :

Étape 1 : Formulation de la requête. Le modèle convertit la question de l'utilisateur en une ou plusieurs requêtes de recherche. Celles-ci sont souvent reformulées — une question conversationnelle comme « comment être cité par les IA » peut devenir une requête structurée « techniques optimisation GEO citation IA 2026 ».

Étape 2 : Récupération. Le moteur de recherche en backend (Bing pour ChatGPT et Copilot, Google pour Gemini, un index propriétaire pour Perplexity) renvoie une liste classée de documents candidats. Ce classement initial repose sur des signaux classiques de recherche d'information — pertinence des mots-clés, autorité du domaine, fraîcheur et structure de la page.

Étape 3 : Extraction de passages. Le modèle n'ingère pas des pages web entières. Il extrait les passages les plus pertinents — typiquement 200 à 500 tokens chacun. C'est ici que la structure du contenu compte énormément. Comme nous le détaillons dans notre article GEO vs SEO, un contenu avec des titres clairs, des H2 sous forme de questions et des réponses en début de paragraphe est extrait de façon plus fiable.

Étape 4 : Synthèse et attribution. Le modèle génère une réponse en tissant ensemble les informations de plusieurs passages récupérés. À cette étape, il décide quelles sources citer, lesquelles paraphraser sans attribution, et lesquelles écarter entièrement.

Qu'est-ce qui rend une source « citable » ? Cinq facteurs clés

La recherche récente a identifié les caractéristiques spécifiques qui rendent un contenu plus susceptible d'être cité dans les réponses générées par l'IA.

1. Clarté du passage et autonomie

Un article de 2024 de Cuconasu et al. (« The Power of Noise: Redefining Retrieval for RAG Systems ») a montré que l'ajout de documents non pertinents ou bruités au contexte de récupération dégrade significativement la qualité des réponses — et que les modèles apprennent à « ignorer » les passages qu'ils trouvent confus ou ambigus.

L'implication : votre contenu doit être auto-explicatif dans chaque section. Un paragraphe qui présuppose un contexte provenant d'ailleurs sur la page, ou qui nécessite la mise en page visuelle pour être compris (tableaux formatés en images, sens véhiculé par des codes couleur), sera ignoré au profit d'un concurrent plus clair.

Action concrète : rédigez chaque section H2 comme si elle pouvait être lue isolément. Incluez suffisamment de contexte dans la phrase d'ouverture pour qu'un lecteur (ou un modèle) comprenne le propos sans avoir à remonter dans la page.

2. Densité factuelle et affirmations vérifiables

L'étude de Princeton sur le GEO (Aggarwal et al., 2023) a démontré que les méthodes Statistics Addition et Quotation Addition sont les deux techniques les plus efficaces pour améliorer la visibilité dans les réponses des moteurs génératifs, avec des gains de citation allant jusqu'à 40 %.

Mais pourquoi ces techniques fonctionnent-elles au niveau du modèle ? Parce que les LLM équipés de capacités de récupération sont de plus en plus entraînés avec des modèles de récompense qui pénalisent l'hallucination. Un passage fournissant une affirmation précise et vérifiable — « le taux de conversion du trafic référé par les IA s'établit en moyenne à 14,2 %, contre 2,8 % pour la recherche organique » — offre au modèle un fait à faible risque qu'il peut inclure directement. Des affirmations vagues comme « le trafic IA convertit beaucoup mieux » n'offrent aucune telle garantie.

Action concrète : visez au moins une affirmation quantitative et sourcée par section H2. Liez vers la source primaire (article académique, rapport sectoriel, documentation officielle) pour que le système de récupération puisse vérifier l'origine de l'affirmation.

3. Effets de position : le biais de primauté

Une découverte fascinante de Liu et al. (2024) (« Lost in the Middle: How Language Models Use Long Contexts ») est que les LLM présentent un fort biais de primauté : les informations en début (et dans une moindre mesure en fin) de la fenêtre de contexte reçoivent une attention disproportionnée. Les informations au milieu tendent à être « perdues ».

Cela a deux implications pour les créateurs de contenu :

- Au sein de votre page : placez vos informations clés en premier. Le bloc TL;DR, le premier paragraphe et la première phrase après chaque titre sont vos espaces à plus forte valeur.

- Au sein des résultats de recherche : être mieux classé dans les résultats de récupération signifie que votre contenu apparaît plus tôt dans la fenêtre de contexte du modèle. Cela renvoie aux fondamentaux du SEO — l'autorité de domaine et les signaux de classement traditionnels comptent encore car ils déterminent votre position dans le contexte récupéré.

4. Autorité de la source et réputation du domaine

Les LLM n'ont pas une base de données de « score de confiance » comme le PageRank de Google. Mais les systèmes de récupération sur lesquels ils s'appuient, si. Quand ChatGPT utilise Bing pour la recherche, les signaux d'autorité de Bing (backlinks, ancienneté du domaine, mentions de marque) déterminent quelles pages sont récupérées en premier lieu.

De plus, une recherche de Vu et al. (2023) a montré que les LLM tendent à citer préférentiellement les sources fréquemment présentes dans leurs données d'entraînement. Des sites comme Wikipédia, Stack Overflow et les grands médias bénéficient d'un avantage cumulatif : ils étaient bien représentés dans les données d'entraînement, le modèle les « connaît » donc, et ils tendent à être bien classés en récupération, ils apparaissent donc en bonne place dans le contexte.

Pour les sites plus petits ou récents, cela signifie que le chemin vers la crédibilité de citation passe souvent par les mentions externes. Être discuté sur Reddit, cité dans des publications sectorielles ou référencé dans les propres sources de Wikipédia — ce sont autant de signaux qui aident un modèle à « reconnaître » votre domaine comme faisant autorité. Construire l'autorité thématique via des clusters de contenu est l'équivalent on-site de cette stratégie.

5. Fraîcheur du contenu et signaux de mise à jour

Les systèmes de récupération pondèrent la fraîcheur de façon explicite. Bing, Google et Perplexity prennent tous en compte les dates de publication et les en-têtes last-modified lors du classement des documents candidats. Une analyse Botify de 2025 a confirmé que le contenu mis à jour dans les 90 derniers jours reçoit significativement plus de citations IA que du contenu plus ancien sur le même sujet.

C'est pourquoi nous recommandons d'afficher un dateModified clair dans vos métadonnées HTML et vos données structurées, et d'utiliser IndexNow pour notifier immédiatement les moteurs de recherche des mises à jour. Plus vite votre contenu mis à jour entre dans l'index de récupération, plus tôt il peut être cité.

Le pipeline d'attribution : comment les modèles décident ce qui obtient un lien

Toute information utilisée par un LLM ne reçoit pas d'attribution. Comprendre le pipeline d'attribution aide à optimiser pour une citation explicite, pas seulement une utilisation passive.

Perplexity est la plateforme la plus favorable aux citations. Son architecture exige une attribution de source explicite pour chaque affirmation factuelle, générant des citations numérotées en ligne. Selon la propre documentation de Perplexity, le système privilégie les sources qui fournissent des réponses directes et concises à la requête spécifique — ce qui s'aligne avec le format de contenu « réponse directe ».

ChatGPT avec recherche fournit des citations en ligne avec des liens, mais est plus sélectif. Les observations issues des données de monitoring suggèrent qu'il cite préférentiellement :

- Les sources qui répondent directement à la question (pas les mentions tangentielles)

- Les sources avec une forte autorité de domaine dans l'index de Bing

- Les sources fournissant des données ou analyses uniques non disponibles ailleurs

Google AI Overviews cite des sources issues des résultats organiques de Google. Comme documenté par Ahrefs, 92,36 % des URLs citées proviennent du top 10 des résultats organiques pour la requête. Cela signifie que l'excellence SEO traditionnelle est un prérequis pour la citation en AI Overview.

Gemini utilise le grounding Google Search lorsqu'il est activé, suivant un schéma similaire aux AI Overviews. Pour les réponses non grounded, il s'appuie sur la connaissance paramétrique — faisant de la présence dans les données d'entraînement le facteur dominant.

Une checklist GEO basée sur la recherche

Sur la base des recherches citées ci-dessus, voici une checklist hiérarchisée pour maximiser vos chances d'être cité par les IA génératives :

-

Structurez pour l'extraction : utilisez des titres H2 sous forme de questions, des paragraphes BLUF, et des sections autonomes. Chaque section doit être compréhensible indépendamment.

-

Maximisez la densité factuelle : incluez au moins une statistique vérifiable ou une citation sourcée par section. Liez vers les sources primaires (articles académiques, rapports sectoriels, documentation officielle).

-

Implémentez un JSON-LD complet : les schémas

Article,Organization,FAQPageetBreadcrumbListfournissent aux systèmes de récupération un contexte structuré sur votre contenu. -

Placez l'essentiel en premier : mettez vos affirmations les plus importantes dans les 200 premiers mots de l'article, la première phrase après chaque titre et dans un bloc TL;DR en tête de page.

-

Maintenez les signaux de fraîcheur : mettez à jour vos articles clés chaque trimestre, affichez le

dateModifieddans le HTML et les données structurées, et utilisez IndexNow pour une réindexation instantanée. -

Construisez l'autorité de domaine pour la récupération : obtenez des backlinks, cultivez des mentions sur Reddit et les plateformes sectorielles, et construisez des clusters de contenu internes qui démontrent votre autorité thématique.

-

Testez sur plusieurs plateformes : surveillez votre présence de citation sur ChatGPT, Perplexity, Gemini et Google AI Overviews séparément. Chaque plateforme a des biais de récupération et des patterns de citation différents.

La suite : recherche agentique et récupération multi-étapes

La prochaine évolution est déjà en cours. Des modèles comme GPT-5 d'OpenAI et Gemini 2.5 de Google s'orientent vers la recherche agentique — où le modèle effectue plusieurs tours de récupération, affinant ses requêtes en fonction des résultats intermédiaires. OpenAI Deep Research illustre ce pattern : une seule question utilisateur déclenche des dizaines de recherches, recoupant les résultats entre sources avant de générer une synthèse.

Pour les créateurs de contenu, cela signifie :

- La profondeur compte plus que la largeur : la recherche agentique trouvera du contenu spécialisé et détaillé qui n'aurait pas émergé dans une récupération à requête unique. Un contenu profond et autoritaire sur des sujets ciblés gagne en valeur.

- La cohérence entre pages compte : si votre site fournit des informations contradictoires sur différentes pages, la recherche agentique détectera l'incohérence et pourra pénaliser votre crédibilité.

- Les données structurées deviennent de la navigation : quand un modèle « parcourt » votre site en plusieurs étapes de récupération, un JSON-LD bien organisé, des liens internes et une architecture de site claire l'aident à comprendre les relations entre vos pages.

Conclusion

Être cité par un LLM n'est pas aléatoire, et ce n'est pas uniquement fonction de votre classement Google. C'est le résultat d'un pipeline — récupération, extraction, évaluation, synthèse, attribution — où chaque étape récompense des caractéristiques spécifiques du contenu.

La recherche est claire : clarté sémantique, densité factuelle, sections autonomes, autorité de la source et fraîcheur du contenu sont les cinq piliers qui déterminent si votre contenu sera cité. Ce ne sont pas des principes abstraits — ils correspondent directement à des attributs de contenu mesurables que vous pouvez auditer et améliorer systématiquement.

Les marques qui comprennent ce pipeline aujourd'hui posent les fondations de leur visibilité IA dans une ère où SEO et GEO deviennent indissociables. Votre contenu n'est plus seulement en compétition pour la première page de Google — il est en compétition pour une place dans la réponse du modèle.